10 Meilleurs logiciels d'analyse de données clients Big Data — Notre sélection

Here's my pick of the 10 best software from the 13 tools reviewed.

Comprendre le monde de l’analyse de données clients Big Data peut s’avérer complexe. Vous avez besoin d’outils qui offrent des analyses puissantes sans ajouter de la complexité. Je sais à quel point il est difficile de trouver un logiciel réellement adapté à vos besoins.

D’après mon expérience, la bonne plateforme d’analyse peut transformer la façon dont votre équipe comprend le comportement client et prend ses décisions basées sur les données. Mon objectif est de vous partager des conseils impartiaux et bien documentés, pour vous aider à choisir en toute confiance.

Vous trouverez ci-dessous un tour d’horizon détaillé des meilleurs outils d’analyse de données clients Big Data disponibles aujourd’hui. J’ai moi-même testé chacun d’eux, vous pouvez donc vous fier à ces recommandations pour vous guider dans votre choix — que vous souhaitiez approfondir la compréhension de vos clients ou prendre des décisions plus éclairées.

Table of Contents

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2020. As CX leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different CX use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé des meilleurs logiciels d'analyse de données clients Big Data

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour le calcul numérique et l’analyse de données | Essai gratuit disponible | À partir de 1 050 $/licence individuelle/an | Website | |

| 2 | Meilleur logiciel d'analyse client en big data pour les données en continu | Offre gratuite disponible à vie | À partir de $1.75/heure | Website | |

| 3 | Idéal pour l’analytics produit | Démo gratuite disponible | À partir de $40/mois | Website | |

| 4 | Idéal pour l'interrogation de grands ensembles de données | Offre gratuite disponible | À partir de $0.50/crédit | Website | |

| 5 | Idéal pour créer des tableaux de bord interactifs et des applications web | Not available | Tarif personnalisé sur demande | Website | |

| 6 | Idéal pour combiner les avantages des data lakes et des entrepôts de données | Essai gratuit de 14 jours disponible | Les forfaits débutent à $0.07/Databricks Unit (DBU) | Website | |

| 7 | Idéal pour la transformation de données dans des environnements cloud | Essai gratuit de 14 jours + version freemium disponible | Les forfaits débutent à $100/par utilisateur développant/par mois | Website | |

| 8 | Meilleur logiciel d'analyse big data pour la création d'un data lakehouse | Essai gratuit + démo disponible | À partir de $0.39/DCU | Website | |

| 9 | Idéal pour créer des produits de données | Plan gratuit avec limitations disponible | Tarification personnalisée sur demande | Website | |

| 10 | Idéal pour l’analytique à grande vitesse | Une version d’essai gratuite est disponible | Les forfaits commencent à $1/heure | Website |

-

SupportYourApp

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

Freshdesk

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.4 -

Zendesk

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.3

Avis sur les meilleurs logiciels d'analyse de données clients Big Data

Utilisez les présentations simples de chaque outil ci-dessous pour comprendre comment chacun se distingue des autres logiciels d’analyse clients Big Data.

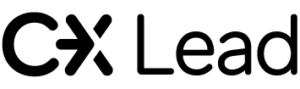

Le programme phare de MathWorks, MATLAB, offre un environnement de programmation aux ingénieurs, scientifiques et analystes de données.

Pourquoi j'ai choisi MATLAB : Le meilleur atout de MATLAB est sa capacité à traiter et à visualiser de grands ensembles de données. De plus, son outil graphique intégré propose diverses options pour visualiser les données en deux et trois dimensions.

MATLAB est devenu de plus en plus populaire ces dernières années grâce à sa vaste bibliothèque d’outils et de fonctions pour le calcul numérique et l’analyse de données. Il propose notamment des boîtes à outils spécialisées pour les analystes de données et les ingénieurs en apprentissage automatique. Ces boîtes à outils peuvent vous aider à construire et évaluer des modèles d'apprentissage automatique, à effectuer le prétraitement des données, à sélectionner et extraire des caractéristiques.

Fonctionnalités et intégrations remarquables de MATLAB

Fonctionnalités comprenant des outils de modélisation 3D/solide, des outils d’édition, de dessin, de rendu, l’analyse par éléments finis, la dynamique multi-corps, la modélisation d’événements discrets et continus, la simulation d’événements mécaniques, la simulation des processus de fabrication, le support matériel et la clarté des commandes.

Intégrations incluant Simulink, Python, Microsoft Excel, LabVIEW, C++, Stateflow, Oracle, Mathcad, SolidWorks, ANSYS, et d’autres solutions logicielles.

Pros and Cons

Pros:

- Excellentes capacités de visualisation

- Large gamme de fonctions

- S'intègre à d'autres langages de programmation

Cons:

- Flexibilité limitée

- Courbe d'apprentissage abrupte

Meilleur logiciel d'analyse client en big data pour les données en continu

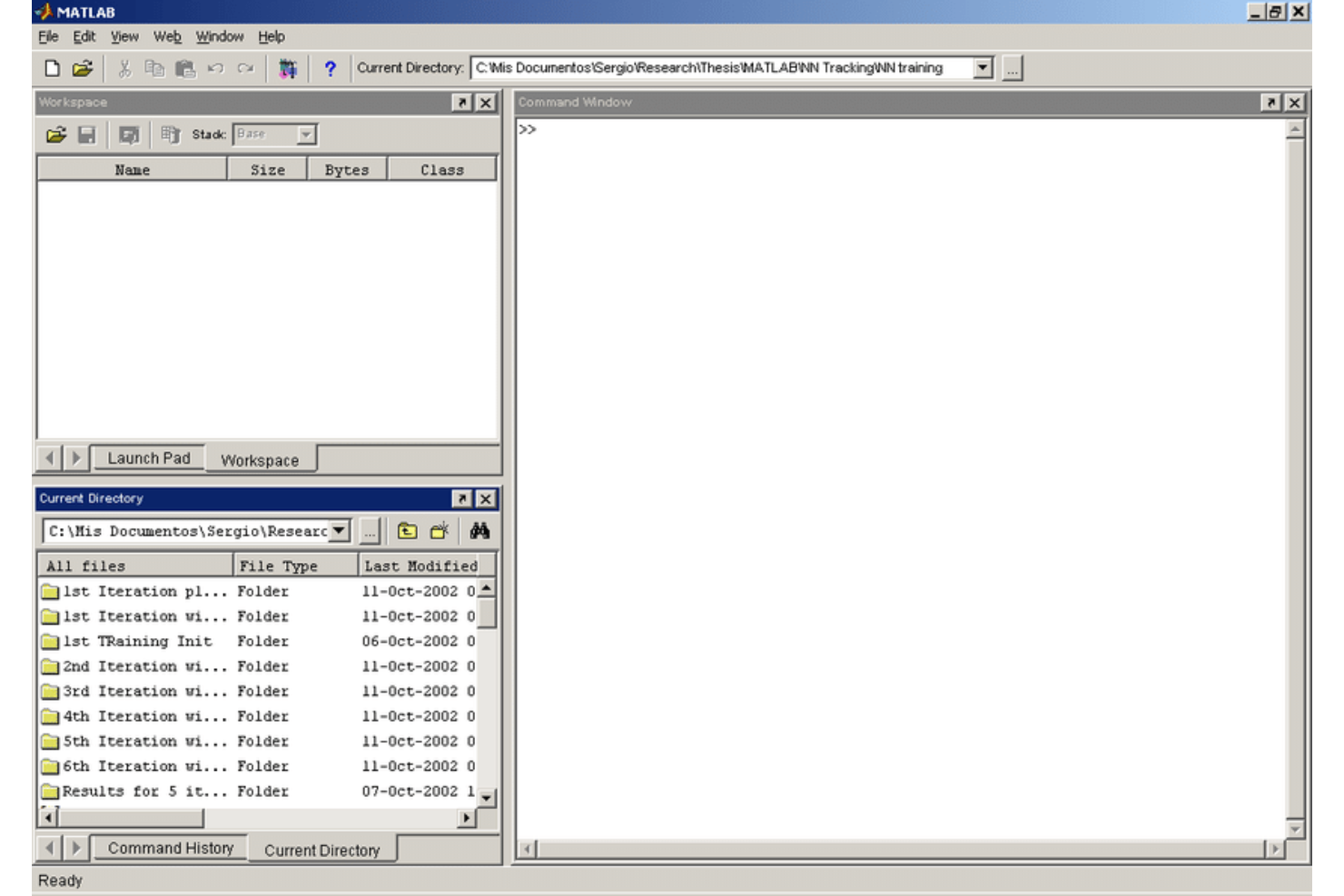

Fondée par les créateurs d'Apache Kafka, Confluent est populaire auprès des ingénieurs et développeurs de données qui ont besoin d'une plateforme évolutive pour travailler avec des données en mouvement.

Pourquoi j'ai choisi Confluent : L'un des aspects intéressants de Confluent est qu'il offre une plateforme unifiée pour les données en mouvement. Elle intègre des données provenant de diverses sources, telles que des bases de données, des applications et des dispositifs IoT. Cela permet aux utilisateurs d'obtenir des informations immédiates grâce aux flux de données.

La capacité de Confluent à fournir une surveillance des données en temps réel, une interface utilisateur intuitive, des fonctionnalités de visualisation des données, ainsi que des options de sécurité et de conformité, en fait un excellent outil pour les analystes de données et les analystes métier. De plus, il utilise Apache Kafka comme technologie de base pour offrir une plateforme évolutive et à faible latence capable de traiter de grands volumes de données en continu.

Fonctionnalités et intégrations remarquables de Confluent

Fonctionnalités : analyses en temps réel, interrogation de données, intégration Hadoop, intégration Spark, analyse multi-source, data lake, visualisation de données, flux de travail des données, découverte gouvernée, traitement de données, sources de données, intégration, traitement en temps réel, reporting et analyses.

Intégrations : Ably, Adobe Experience Platform, Aerospike, Amazon S3, Azure Cosmos DB, Azure Data Explorer, Couchbase, Crux, DataStax, Datadog et d'autres logiciels.

Pros and Cons

Pros:

- Documentation bien organisée

- Assure la surveillance en temps réel des données

- Bon service client

Cons:

- Nécessite une expertise technique

- Configuration complexe

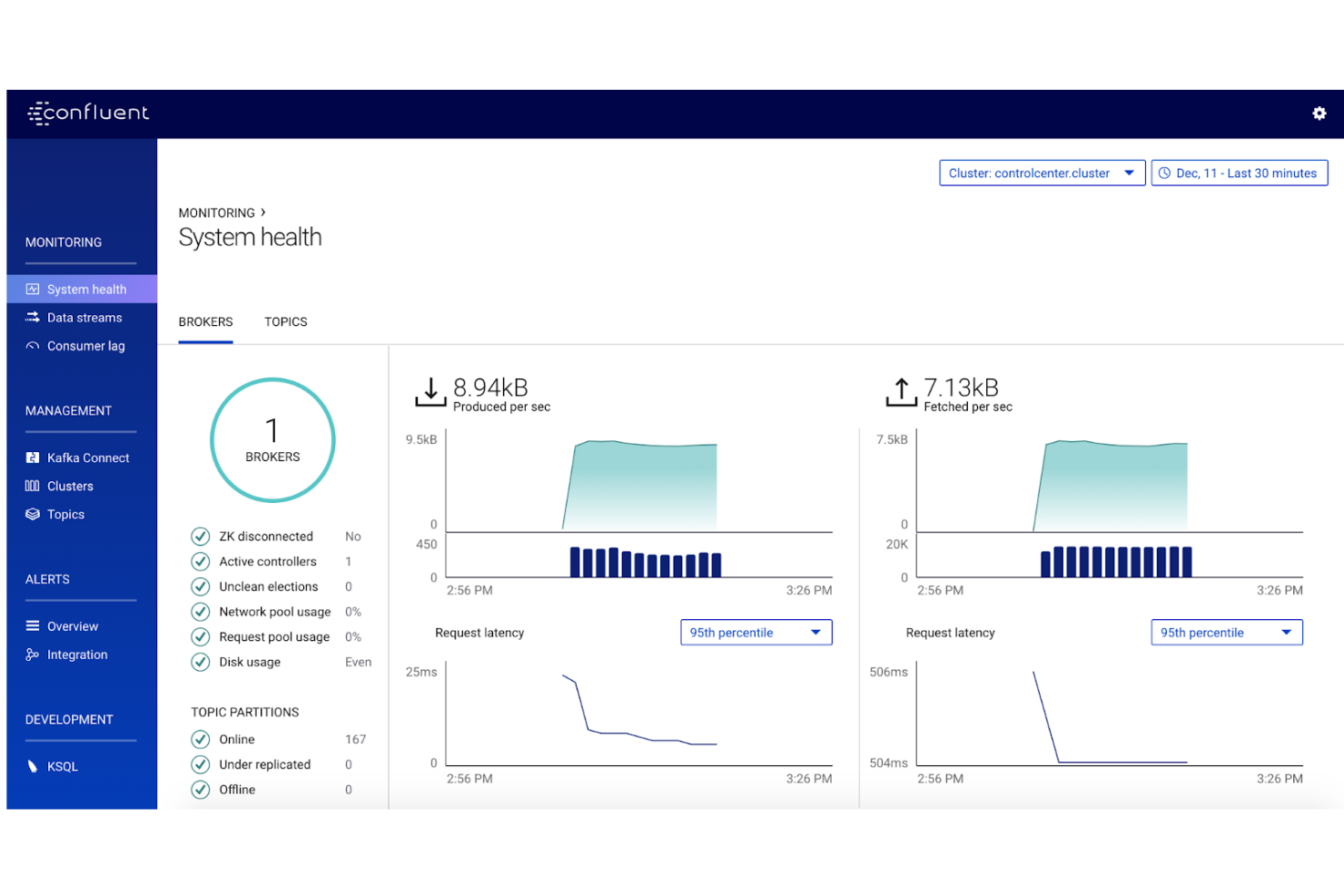

Countly est une plateforme d’analyse produit qui vous aide à comprendre comment les utilisateurs interagissent avec vos applications mobiles, web et de bureau. Elle fournit des informations en temps réel sur le comportement des utilisateurs, vous permettant ainsi de prendre des décisions éclairées pour améliorer vos produits.

Pourquoi j'ai choisi Countly : Cette solution propose un ensemble de fonctionnalités étendu, conçu pour une analyse approfondie. Des fonctionnalités telles que les profils utilisateurs et les cohortes vous permettent de segmenter efficacement votre audience, vous aidant à identifier des schémas et des tendances au sein de différents groupes d’utilisateurs.

J’apprécie également les capacités de collecte et de visualisation des données en temps réel de Countly. Vous pouvez surveiller les actions des utilisateurs au fur et à mesure qu’elles se produisent, ce qui est crucial pour prendre des décisions en temps voulu. Cette immédiateté vous permet de réagir rapidement au comportement des utilisateurs, d’optimiser l’expérience utilisateur et de résoudre les problèmes avec réactivité.

Principales fonctionnalités et intégrations de Countly

Fonctionnalités incluent l’analyse de la rétention, les entonnoirs, les cartes de chaleur, les notifications push, les enquêtes, l’analyse des horaires, la configuration à distance, le hub de conformité, la sécurité reCAPTCHA, l’analyse des utilisateurs et les tableaux de bord.

Intégrations incluent Facebook Leads, Google Sheets, TiktokLeadGeneration, Gmail, Facebook Offline Conversions, Mailchimp, Slack, Shopify, Trello, Telegram, Discord et WooCommerce.

Pros and Cons

Pros:

- Prend en charge le suivi multiplateforme

- Propose un déploiement sur site pour un contrôle total des données

- Fournit une analyse complète du comportement utilisateur

Cons:

- Certaines intégrations sont limitées aux forfaits supérieurs

- Certains utilisateurs rapportent des difficultés avec les résultats de requêtes complexes

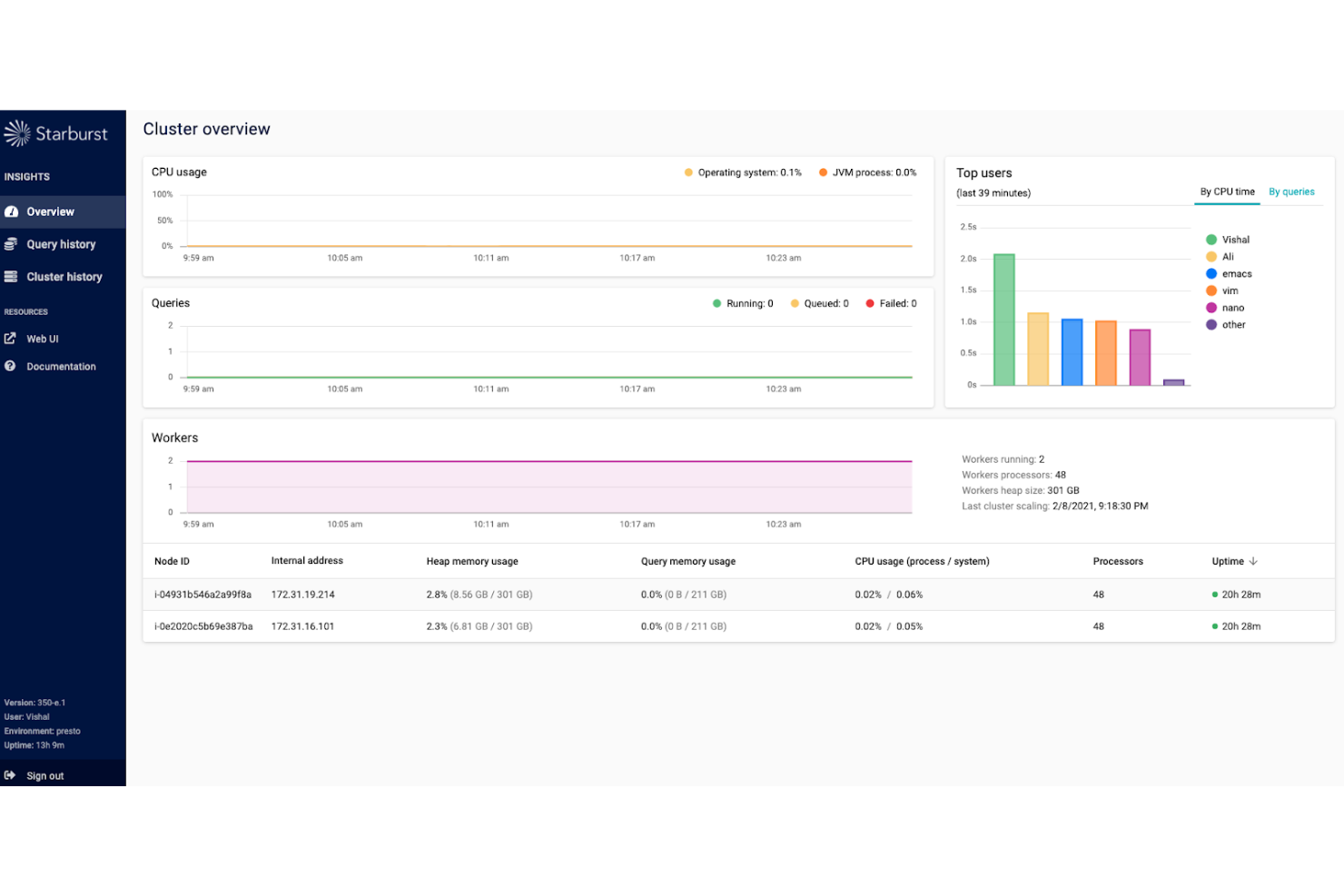

Starburst aide les entreprises à interroger de grandes quantités de données et agit comme source unique de vérité pour vos données.

Pourquoi j'ai choisi Starburst : Les processus traditionnels de préparation et d'ETL des données sont longs et lents. Starburst permet une analyse ad hoc sans nécessiter de processus ETL. Il traite rapidement les données provenant de plusieurs sources et fournit des résultats en quelques secondes. De cette façon, les organisations peuvent accélérer leur mise sur le marché et améliorer leur prise de décision.

De plus, Starburst propose des fonctionnalités comme un contrôle d'accès granulaire, le masquage des données et le chiffrement de bout en bout pour garantir la sécurité des données. En outre, il s'intègre avec des fournisseurs d'authentification comme LDAP ou Kerberos, ce qui assure l'authentification et permet aux administrateurs de contrôler l'accès aux ressources. Starburst propose également un large éventail de connecteurs afin que les organisations puissent facilement accéder aux données issues de diverses sources.

Fonctionnalités et intégrations phares de Starburst

Fonctionnalités comprennent un moteur de requête SQL, une architecture distribuée, la sécurité et la gouvernance des données, des options de déploiement cloud-natif, la gestion multi-clusters, ainsi que des services de conseil et de formation.

Intégrations comprennent Accumulo, Google Big Query, Cassandra, Clickhouse, Delta Lake, Druid, Amazon DynamoDB, Elasticsearch, Greenplum, JDBC, et d'autres options logicielles.

Pros and Cons

Pros:

- Haute scalabilité

- Support 24h/24 et 7j/7

- Permet une interrogation rapide des données

Cons:

- Dépend de sources de données externes pouvant impacter la performance

- Nécessite une maintenance continue

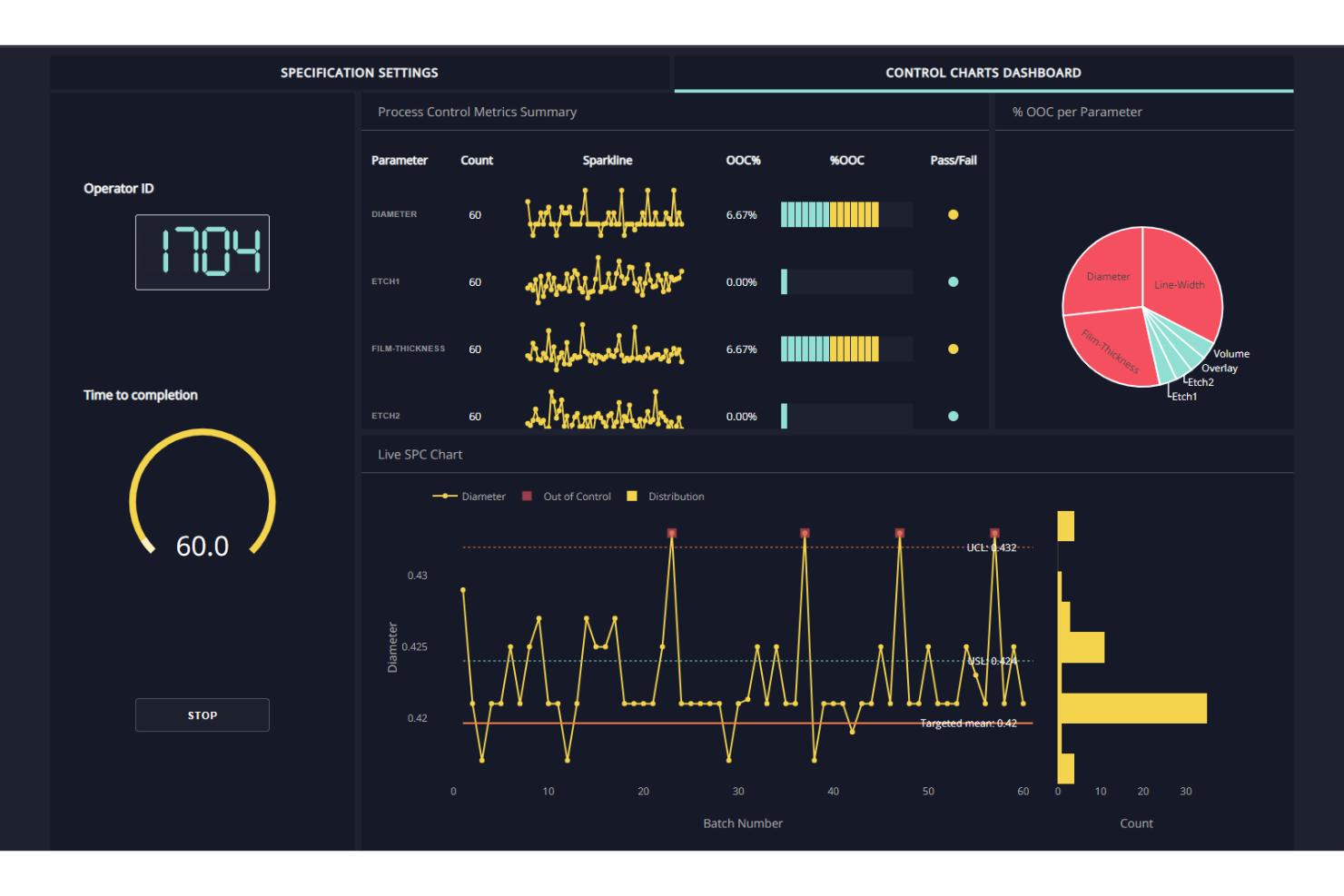

Idéal pour créer des tableaux de bord interactifs et des applications web

Dash Enterprise aide les data scientists, analystes et développeurs à créer des tableaux de bord et des applications personnalisés sans passer des heures à coder ou à gérer une infrastructure complexe.

Pourquoi j'ai choisi Dash Enterprise : La fonctionnalité qui distingue Dash Enterprise des autres plateformes de tableaux de bord est son intégration de modèles d'apprentissage automatique dans les tableaux de bord. Ainsi, les utilisateurs peuvent analyser et visualiser des données en temps réel, identifier des tendances et faire des prédictions.

De plus, il permet aux utilisateurs de collaborer sur des tableaux de bord et des applications avec des personnes de leur organisation ou avec des parties prenantes externes. Il fournit des fonctionnalités de sécurité de niveau entreprise telles que le contrôle d'accès basé sur les rôles, le chiffrement SSL et l'intégration LDAP. Il peut également gérer de grands ensembles de données, ce qui le rend idéal pour les usages à l'échelle de l'entreprise.

Fonctionnalités et intégrations remarquables de Dash Enterprise

Fonctionnalités : espaces de travail pour les applications de données, kit de conception, catalogue d'applications d'IA, moteur de rapports, moteur de tableaux de bord, gestionnaire d'applications, file d'attente de tâches, intégration dans d'autres sites, système de fichiers, intégration de bases de données, CI/CD, middleware d'authentification et intégration avec Databricks.

Intégrations : Databricks, MySQL, Postgres, Snowflake, Google BigQuery, Amazon RedShift, MS Azure SQL, Redis, MongoDB, Elasticsearch, Salesforce et d'autres logiciels.

Pros and Cons

Pros:

- Interface utilisateur simple

- Bonne assistance de la communauté

- Configuration et mise en route faciles

Cons:

- Le support client doit être amélioré

- La documentation est incomplète

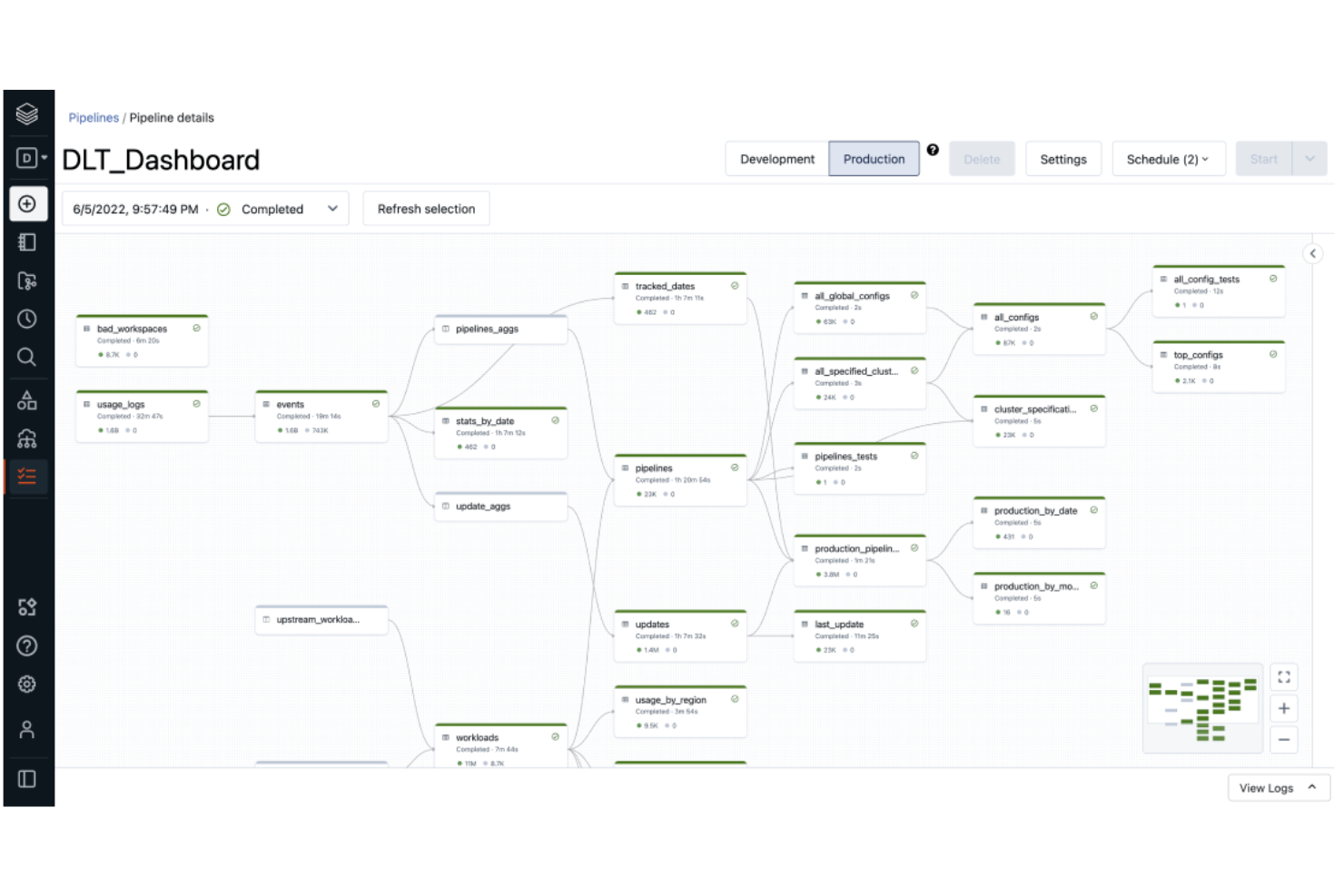

Idéal pour combiner les avantages des data lakes et des entrepôts de données

La plateforme Databricks Lakehouse offre une architecture Lakehouse aux entreprises souhaitant unifier l'entreposage de données et l'analytique sur une seule plateforme.

Pourquoi j'ai choisi la plateforme Databricks Lakehouse : Elle s’intègre à Delta Lake, un format de données open source qui fournit des transactions ACID, l’application des schémas et d’autres optimisations de performance pour le stockage cloud. Delta Lake permet aux organisations de gérer des charges de travail complexes, tout en garantissant la cohérence, la fiabilité et la précision des données, ce qui en fait un élément essentiel de l’architecture Lakehouse.

Elle est idéale pour les entreprises devant traiter et analyser de grands volumes de données issus de différentes sources de façon évolutive, économique et sécurisée. Elle est particulièrement utile pour les équipes d’ingénierie et de science des données souhaitant collaborer sur des projets de données, car elle fournit une plateforme unifiée pour la création, la gestion et le déploiement de pipelines de données. De plus, elle peut prendre en charge le traitement des données par lots comme en streaming grâce au format Delta Lake, garantissant cohérence, fiabilité et précision des données.

Fonctionnalités et intégrations phares de la plateforme Databricks Lakehouse

Fonctionnalités : collecte de données en temps réel, data lake, distribution de données, intégration Hadoop, intégration Spark, montée en charge des machines, préparation des données, traitement cloud, gestion des charges de travail, intégration de données, compression de données, intégration data lake et scalabilité.

Intégrations : Fivetran, arcion, Rivery, dbt, Prophecy, Tableau, Microsoft Power BI, Hex, Salesforce, Google Analytics, et d’autres logiciels.

Pros and Cons

Pros:

- Offre une plateforme unifiée pour la diffusion et l’ingestion de données

- Inclut des outils de visualisation de données intégrés

- Fournit des fonctions SQL avancées

Cons:

- L’expérience utilisateur doit être améliorée

- L’explorateur de données peut être lent

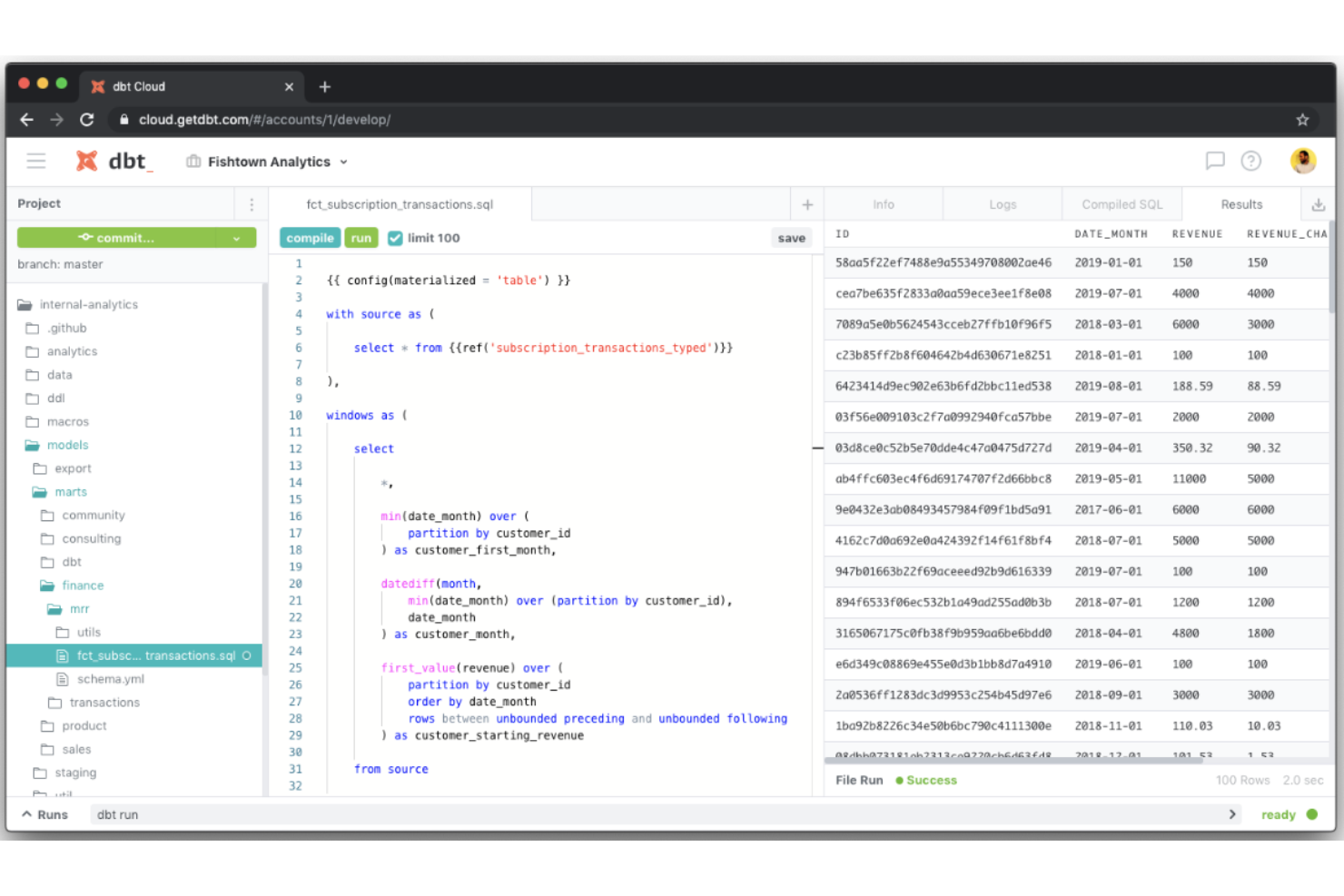

dbt (Data Build Tool) est un outil de transformation de données populaire qui aide les analystes et ingénieurs de données à réaliser l’étape de ‘transformation’ dans le pipeline Extract-Transform-Load (ETL).

Pourquoi j’ai choisi dbt : Lorsqu’on travaille sur un pipeline de données complexe et volumineux, les membres de l’équipe travaillent généralement en même temps sur différents aspects du pipeline, ce qui peut entraîner des modifications conflictuelles. La fonction de contrôle de version de dbt élimine ce risque puisqu’elle permet aux utilisateurs de conserver un historique des changements, et il est possible de revenir à une version antérieure si nécessaire.

Cet outil s’adresse aux professionnels de la donnée et aux organisations qui rencontrent des difficultés avec la transformation et le stockage des données. L’intégrer à votre flux de travail vous aidera à réduire votre charge de travail. De plus, la fonction de tests intégrée garantit l’exactitude des transformations.

Fonctionnalités et intégrations phares de dbt

Fonctionnalités : IDE accessible depuis un navigateur, planification des jobs, exécutions illimitées par jour, journalisation et alertes, documentation des données, rapports de fraîcheur des sources, intégration continue, accès API, couche sémantique, authentification unique (SSO), nombreux espaces de déploiement, accords de niveau de service (SLA), contrôles d’accès basés sur les rôles, permissions Git détaillées, audit logging, et support natif pour GitHub, GitLab et Azure DevOps.

Intégrations : AlloyDB, Amazon Redshift, BigQuery, Databricks, Snowflake, Deepnote, Hex, Houseware, Lightdash, Mode, et d’autres logiciels.

Pros and Cons

Pros:

- Génère automatiquement la documentation

- Communauté Slack active

- Fonctionnalités de test intégrées

Cons:

- Les utilisateurs doivent maîtriser SQL et la modélisation des données

- Support limité pour les bases de données non SQL

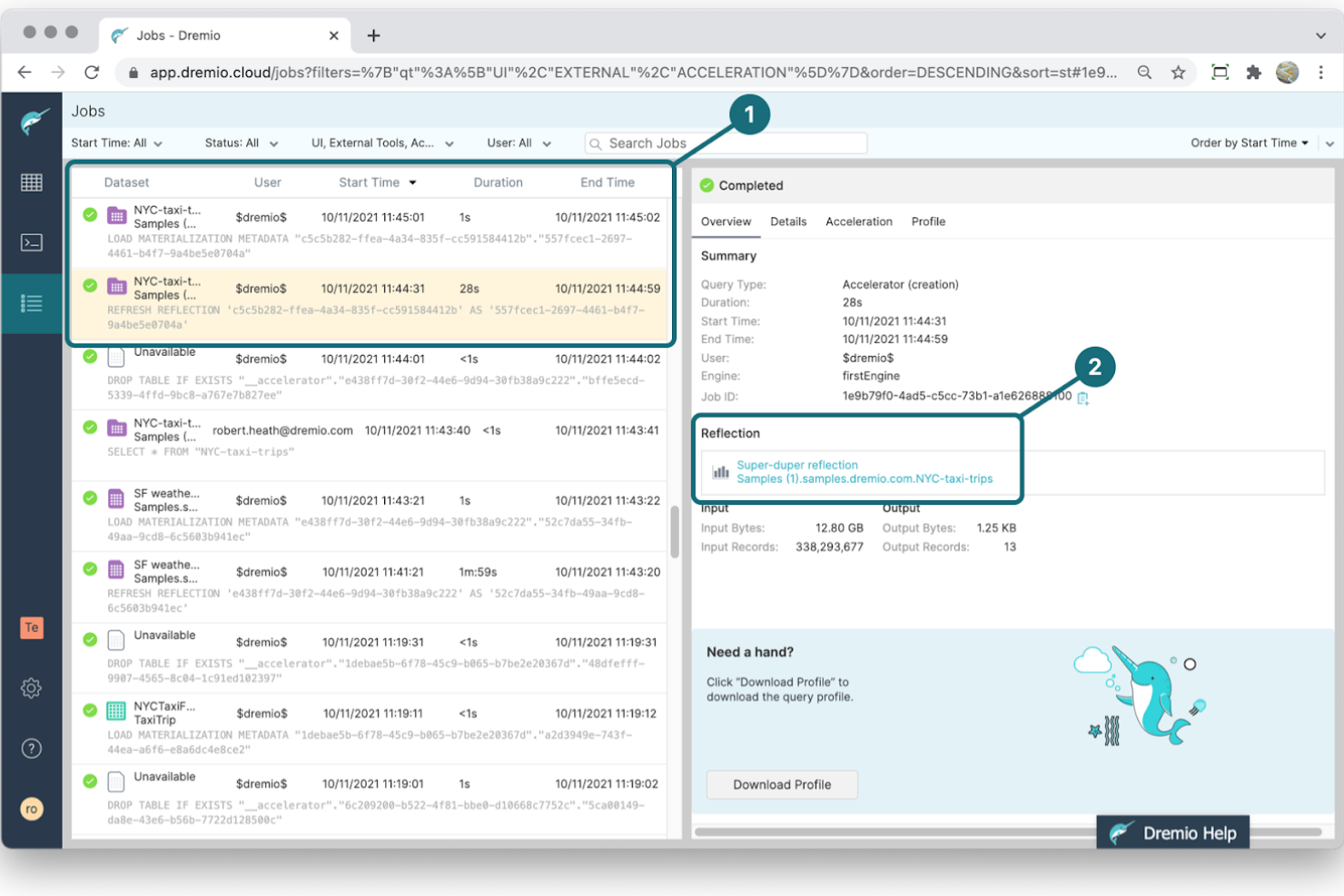

Dremio est une plateforme data-as-a-service (DAAS) qui fournit des outils d'analyse en libre-service aux analystes de données, ingénieurs et responsables métier.

Pourquoi j'ai choisi Dremio : La meilleure fonctionnalité de Dremio est sa capacité à accélérer les performances des requêtes grâce aux Reflections. Ce sont des structures de données pré-agrégées et indexées qui facilitent et accélèrent l’analyse des données. De plus, Dremio actualise automatiquement les reflections afin que les résultats des requêtes soient toujours à jour.

De plus, Dremio peut vous aider à moderniser les systèmes existants, migrer une infrastructure héritée vers le cloud, mettre à jour un data lakehouse existant et lancer de nouveaux projets. Il propose également une interface simple et une documentation de qualité, facilitant ainsi la résolution des problèmes éventuels.

Fonctionnalités et intégrations phares de Dremio

Fonctionnalités comprennent une plateforme lakehouse, un plan de contrôle global, une évolutivité et une simultanéité infinies, la curation et le partage de données en libre-service, la gouvernance et la traçabilité intégrées, l'accélération transparente des requêtes, SQL DML sur le lakehouse, l'intégration d'outils BI, les journaux d'audit, l'intégration avec des fournisseurs d'identité sociale, la conformité SOC 2 Type 2, ISO 27001, HIPAA, le support de la communauté, l'intégration avec des fournisseurs d'identité d'entreprise, le masquage des données et la synchronisation SCIM.

Intégrations incluent Airbyte, Alteryx, AWS, Collibra, dbt Labs, GoodData, intel, IBM, Microsoft, Okera, et d'autres solutions logicielles.

Pros and Cons

Pros:

- Requêtes rapides

- Interface intuitive

- Bonnes fonctionnalités de gouvernance des données

Cons:

- Peut demander des ressources matérielles supplémentaires

- Nécessite des outils BI tiers

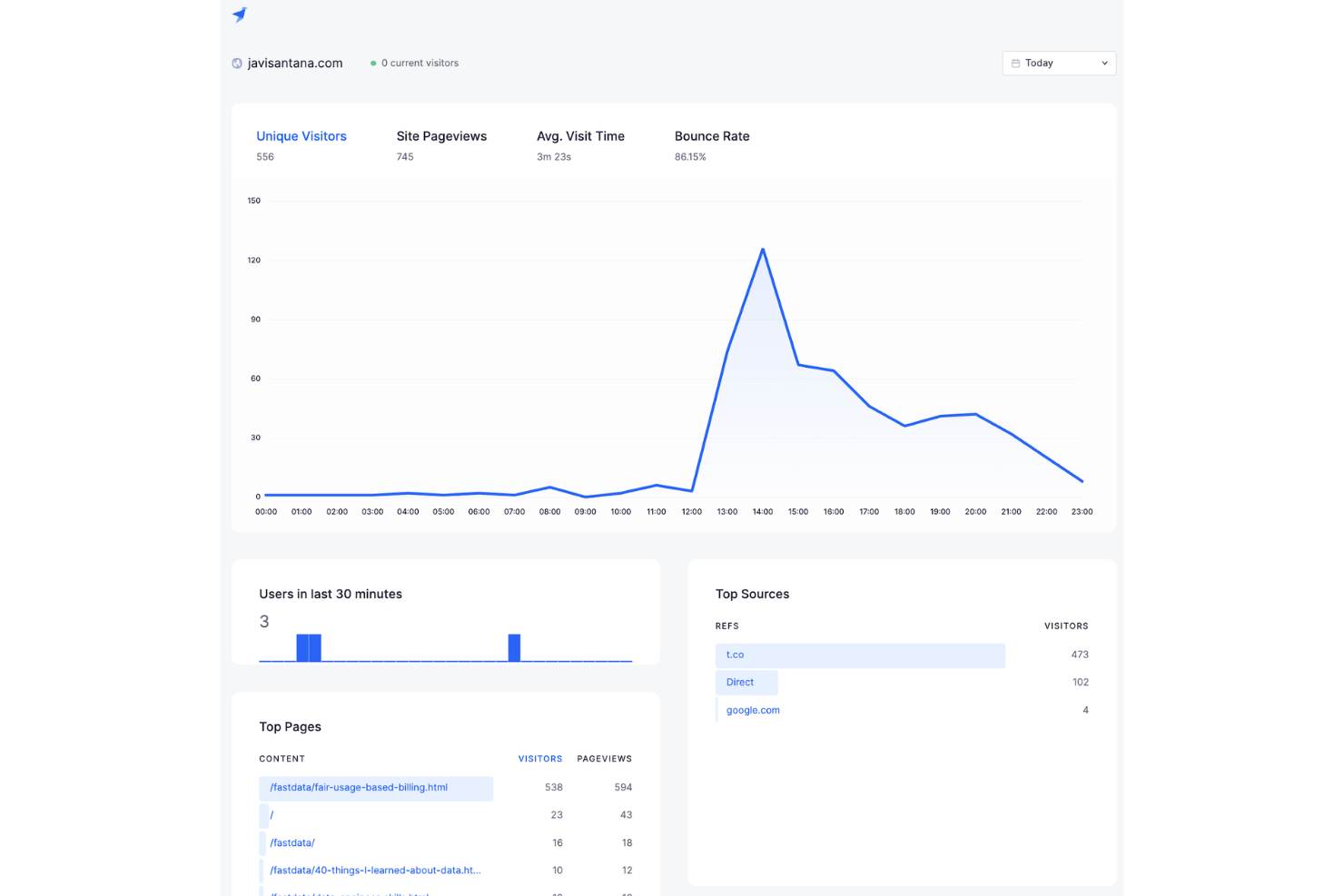

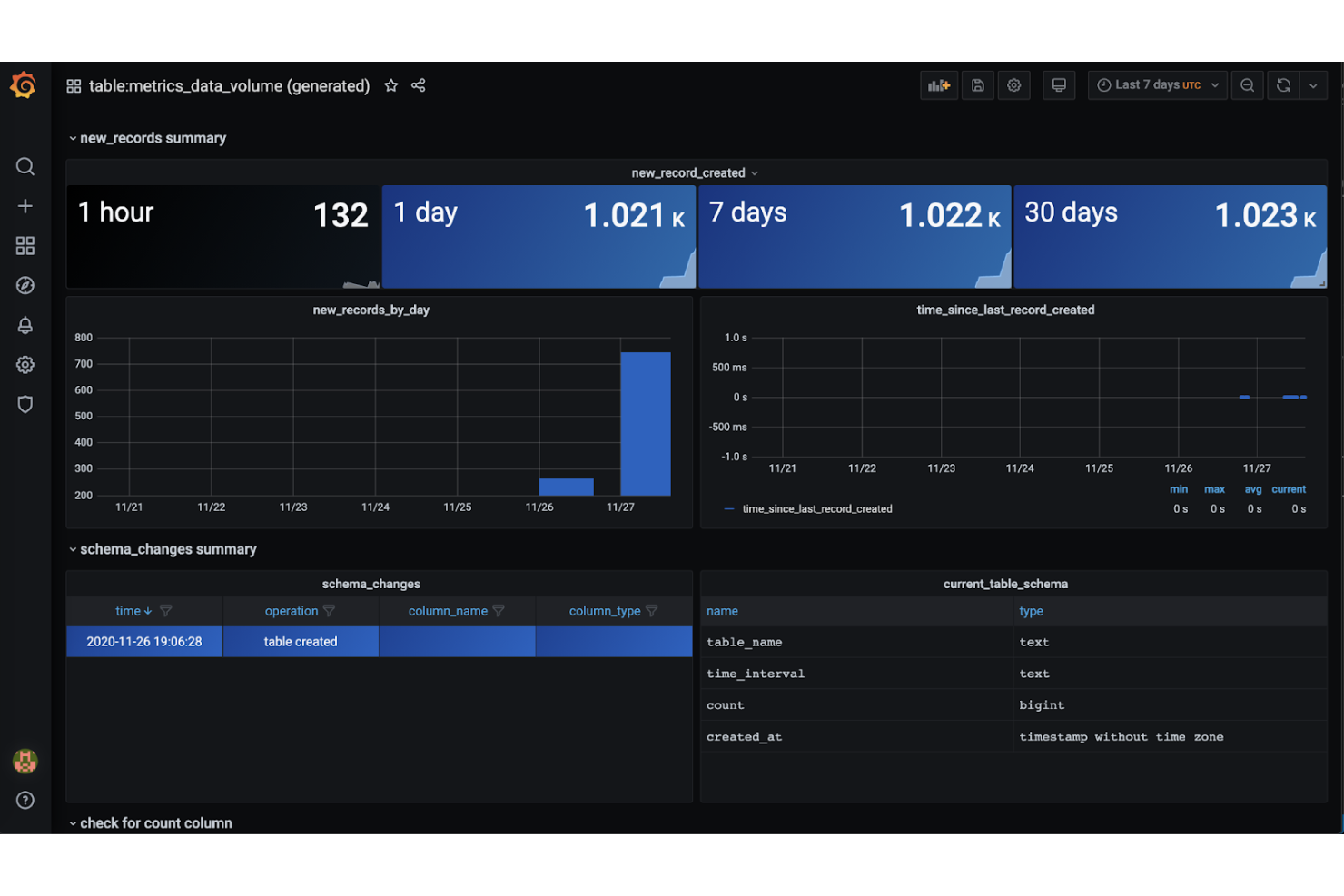

Tinybird est une plateforme d'analyse de données destinée aux développeurs qui souhaitent créer des produits de données en temps réel à grande échelle à l'aide d'API basées sur SQL.

Pourquoi j'ai choisi Tinybird : Le meilleur aspect de Tinybird est son architecture, qui permet un traitement et une analyse des données en temps réel très rapides. Le stockage de données en mémoire de la plateforme et les connecteurs préinstallés vers des sources de données populaires offrent des performances de requête ultrarapides. Il utilise un langage de requête basé sur SQL, ce qui permet aux développeurs d'exploiter leurs compétences existantes pour analyser les données.

Tinybird est une solution idéale pour les organisations à la recherche d'une plateforme de traitement de données robuste et évolutive. Elle est particulièrement adaptée aux cas d'usage nécessitant des temps de réponse rapides et une faible latence, comme l'analytique en temps réel, la surveillance et l'alerte.

Fonctionnalités et intégrations phares de Tinybird

Fonctionnalités incluent des utilisateurs illimités, des sources de données illimitées, des connecteurs de données, la prise en charge multi-région, des points de terminaison API illimités, la matérialisation en temps réel, la sécurisation des données et un support technique.

Intégrations incluent Node, Python, Schedule, Data Stores, Airtable, GitHub, Filter, Bash, Twilio, Discord, MySQL, AWS et d'autres options logicielles.

Pros and Cons

Pros:

- Propose des connecteurs de données préinstallés

- Interface utilisateur simple et intuitive

- API facile à utiliser

Cons:

- Moins accessible pour les organisations disposant de petits budgets

- Nécessite des connecteurs personnalisés pour les sources de données spécialisées

Exasol est un système de base de données en mémoire idéal pour les organisations des secteurs nécessitant une forte intensité de données, comme la finance, la santé et le commerce électronique.

Pourquoi j'ai choisi Exasol : La technologie en mémoire d’Exasol permet le stockage des données dans la mémoire de l’ordinateur plutôt que sur disque, offrant ainsi un accès et une analyse des données en temps réel à grande vitesse. De plus, elle repose sur une architecture sans partage, ce qui répartit la charge de travail sur plusieurs nœuds ou ordinateurs et autorise ainsi le traitement en parallèle.

Un autre aspect remarquable d’Exasol est ses capacités d’apprentissage automatique qui permettent aux utilisateurs d’effectuer des analyses de données avancées et des tâches de prédiction. Les utilisateurs peuvent créer, entraîner et déployer des modèles de machine learning directement au sein du système de base de données. Ceci permet une analyse de données plus rapide et plus efficace, puisqu'il n'est pas nécessaire de transférer les données vers des outils d’apprentissage automatique externes pour l’analyse.

Fonctionnalités et intégrations remarquables d’Exasol

Fonctionnalités comprennent : base de données distribuée, SQL standard, clés de distribution, matériel standard, profilage, commande IMPORT, commande EXPORT, interface XML/RPC, documentation, schémas virtuels, transactions ACID, tables système, audit, gestion des sessions, gestion des utilisateurs, scripts Lua, scripts de prétraitement, scripts UDF, machine learning, requêtes skyline, données géospatiales, ensembles de regroupement et connecteurs.

Intégrations incluent Amazon QuickSight, Business Objects, IBM Cognos, Looker, Metabase, Pentaho, Amazon Kinesis, Keboola, Kafka, Python, SQL et d’autres options logicielles.

Pros and Cons

Pros:

- Grande vitesse de traitement

- Fonctionnalités de sécurité robustes

- Prise en charge du SQL standard

Cons:

- Petite communauté de développeurs et d’utilisateurs

- Fonctionnalités limitées pour les données non structurées

Autres logiciels d'analyse de données clients Big Data

Voici quelques autres solutions d’analyse de données clients Big Data qui n’apparaissent pas dans ma sélection, mais qui méritent tout de même d’être explorées :

Critères de sélection des logiciels d’analyse de données clients Big Data

Pour sélectionner les meilleurs outils d’analyse de données clients Big Data pour cette liste, j’ai pris en compte les besoins des acheteurs et leurs points de douleur courants comme la capacité d’intégration des données et la simplicité d’utilisation. J’ai aussi utilisé la structure suivante pour garantir une évaluation juste et structurée :

Fonctionnalité principale (25% de la note globale)

Pour figurer dans cette liste, chaque solution devait répondre à ces cas d’utilisation courants :

- Collecte et stockage de données

- Segmentation client

- Analyses prédictives

- Traitement des données en temps réel

- Rapports et visualisation

Fonctionnalités distinctives (25% de la note globale)

Pour affiner davantage la sélection, j’ai également recherché des fonctionnalités uniques telles que :

- Tableaux de bord personnalisables

- Analyses assistées par IA

- Intégration avec des outils tiers

- Chiffrement avancé des données

- Support multilingue

Facilité d’utilisation (10% de la note globale)

Afin d’appréhender l’ergonomie de chaque solution, j’ai pris en compte les éléments suivants :

- Navigation intuitive

- Design et mise en page clairs

- Interface personnalisable

- Courbe d’apprentissage réduite

- Design responsive

Onboarding (10% de la note globale)

Pour évaluer l’expérience d’intégration sur chaque plateforme, j’ai pris en compte :

- Disponibilité de vidéos de formation

- Tours de produit interactifs

- Accès à des webinaires

- Présence de chatbots

- Guides utilisateurs complets

Support client (10% de la note globale)

Pour évaluer le service client de chaque éditeur, j’ai pris en compte :

- Support disponible 24/7

- Multiples canaux de support

- Délai de réponse

- Qualité des ressources d’aide

- Forums communautaires utilisateurs

Rapport qualité/prix (10% de la note globale)

Pour évaluer la rentabilité de chaque plateforme, j’ai pris en compte :

- Des tarifs compétitifs

- Différents niveaux de tarification

- Disponibilité d’un essai gratuit

- Transparence sur les coûts

- Ratio fonctionnalité/prix

Avis clients (10% de la note globale)

Pour évaluer la satisfaction globale, voici ce que j’ai examiné dans les retours clients :

- Note globale de satisfaction

- Forces fréquemment mentionnées

- Points faibles souvent cités

- Fréquence des mises à jour

- Taux de recommandation utilisateur

Comment choisir un logiciel d’analyse de données clients Big Data

Il est facile de se perdre dans des listes de fonctionnalités interminables et des grilles tarifaires complexes. Pour vous aider à rester concentré lors de votre processus de sélection, voici une liste de points à vérifier :

| Facteur | À considérer |

|---|---|

| Scalabilité | Le logiciel peut-il gérer votre croissance de données ? Vérifiez qu’il répondra à vos besoins futurs sans nécessiter de transformations lourdes. Attention à la limite d’utilisateurs, de stockage ou à la capacité du système. |

| Intégrations | Le logiciel s’intègre-t-il à vos systèmes existants ? Pensez aux APIs, aux applications tierces et aux connexions natives. Privilégiez la souplesse de connexion avec des outils CRM, ERP ou BI. |

| Personnalisation | Est-il possible d’adapter l’outil à vos flux de travail ? Vérifiez les tableaux de bord, rapports et rôles utilisateur. Évitez les logiciels au fonctionnement rigide qui ne correspondrait pas à vos processus. |

| Simplicité | À quelle vitesse votre équipe pourra-t-elle prendre en main le logiciel ? Recherchez une interface intuitive et des instructions claires. Évitez les systèmes trop complexes nécessitant une formation prolongée. |

| Implémentation et onboarding | Évaluez le temps et les ressources nécessaires au démarrage. Préférez un paramétrage simple, des formations disponibles et un accompagnement lors de l’onboarding. Évitez les configurations longues ou complexes. |

| Coût | Comparez les plans tarifaires avec votre budget. Prenez en compte les frais cachés, les coûts liés à la scalabilité et les conditions contractuelles. Privilégiez la transparence et la rentabilité. |

| Sécurité | Le logiciel répond-il à vos exigences de protection des données ? Vérifiez le chiffrement, le contrôle des accès et la conformité (RGPD, etc.). Évitez les solutions aux mesures de sécurité faibles. |

| Support | Quel niveau d’assistance est proposé ? Privilégiez le support 24/7, de multiples moyens de contact et une base de connaissances complète. Fuyez les éditeurs dont le support est restreint ou lent. |

Qu’est-ce qu’un logiciel d’analyse de données clients Big Data ?

L’analyse de données clients Big Data regroupe des outils qui exploitent de très gros volumes de données clients afin de révéler des tendances et des insights. Les professionnels du marketing, les analystes de données et les stratèges métier utilisent généralement ces outils pour mieux comprendre le comportement client et améliorer la prise de décision.

L’intégration de données, l’analyse prédictive et les fonctions de reporting aident à repérer les schémas et à renforcer l’engagement client. Globalement, ces solutions fournissent des informations clés pour piloter des stratégies commerciales éclairées.

Fonctionnalités

Lors de votre choix d’un logiciel d’analyse de données clients Big Data, gardez un œil sur les fonctionnalités suivantes :

- Intégration de données : Connecte différentes sources pour offrir une vue unifiée de la clientèle.

- Analyses prédictives : Utilise les données historiques pour anticiper tendances et comportements futurs.

- Reporting et visualisation : Propose des représentations visuelles simples pour faciliter la prise de décision.

- Tableaux de bord personnalisables : Permet de configurer l’espace de travail en fonction de métriques ou insights précis.

- Insights pilotés par l’IA : Offre des analyses automatisées et des recommandations issues de modèles avancés.

- Traitement des données en temps réel : Permet d’analyser/agir immédiatement sur les interactions clients au fil de l’eau.

- Interface intuitive : Garantit une prise en main rapide pour tous les utilisateurs.

- Chiffrement des données : Sécurise les informations sensibles grâce à des mesures de sécurité avancées.

- Support multilingue : Permet une utilisation par des équipes dans différentes régions/avec différentes langues.

- Intégrations tierces : Se connecte efficacement à d’autres outils métiers (CRM, ERP, etc.) pour plus de simplicité.

Bénéfices

La mise en œuvre de l’analytique client basée sur le big data offre plusieurs avantages pour votre équipe et votre entreprise. En voici quelques-uns dont vous pourrez profiter :

- Meilleure prise de décision : Analyse de grands ensembles de données pour fournir des insights qui orientent les stratégies commerciales.

- Compréhension client enrichie : Offre une vue détaillée des comportements et préférences clients grâce à l’intégration des données.

- Capacités prédictives : Prédit les tendances futures grâce à l’analyse prédictive, vous permettant d’anticiper les besoins des clients.

- Efficacité accrue : Automatise le traitement et l’analyse des données, économisant du temps et des ressources pour votre équipe.

- Sécurité renforcée : Protège les données clients avec le chiffrement, garantissant la conformité aux réglementations sur la protection des données.

- Meilleur engagement : Personnalise les efforts marketing et les interactions clients en s’appuyant sur les insights générés par l’IA.

- Portée mondiale : Prend en charge plusieurs langues, permettant aux entreprises de s’adresser à une clientèle diversifiée.

Coûts & Tarification

Choisir une solution d’analyse client big data nécessite de bien comprendre les différents modèles et plans tarifaires disponibles. Les coûts varient selon les fonctionnalités, la taille de l’équipe, les modules additionnels, et bien plus. Le tableau ci-dessous résume les formules courantes, leurs tarifs moyens et les fonctionnalités typiques comprises dans les solutions d’analytique client big data :

Tableau comparatif des offres pour l’analytique client big data

| Type d’offre | Prix moyen | Fonctionnalités courantes |

|---|---|---|

| Formule gratuite | 0 $ | Analytique de base, stockage de données limité et support communautaire. |

| Formule personnelle | 10 $–30 $/utilisateur/mois | Analytique avancée, tableaux de bord personnalisables et assistance par e-mail. |

| Formule entreprise | 50 $–100 $/utilisateur/mois | Analytique en temps réel, options d’intégration et support prioritaire. |

| Formule grand compte | 150 $–300 $/utilisateur/mois | Intégration complète des données, responsable de compte dédié et sécurité renforcée. |

Big Data Customer Analytics Software FAQs

Voici des réponses aux questions fréquemment posées sur l’analytique client big data :

Les solutions d’analyse client big data peuvent-elles s’intégrer aux systèmes existants ?

Oui, la plupart des solutions proposent des intégrations avec d’autres outils d’entreprise comme les CRM et ERP. Cela permet un flux de données sans couture entre les plateformes, améliorant la précision et l’utilisabilité des données. Avant d’acheter, vérifiez la compatibilité avec vos systèmes existants pour éviter tout problème d’intégration.

Comment garantir la confidentialité des données avec l’analytique client big data ?

Choisissez un outil doté de mesures de sécurité robustes telles que le chiffrement et le contrôle des accès. Vérifiez la conformité avec des réglementations comme le RGPD. Mettez régulièrement à jour votre logiciel et formez votre équipe aux bonnes pratiques de la protection des données pour minimiser les risques.

Est-il nécessaire d’avoir une expertise technique pour utiliser l’analytique client big data ?

Non, de nombreux outils sont conçus pour les utilisateurs non techniques avec des interfaces intuitives et des guides de configuration. Cependant, certaines fonctions avancées peuvent exiger un savoir-faire technique. Privilégiez les solutions offrant des ressources d’accompagnement complètes, comme des tutoriels et un support client, pour vous aider à tirer parti des fonctionnalités avancées.

Comment ces logiciels gèrent-ils de grands volumes de données ?

Ces outils reposent généralement sur des architectures informatiques distribuées qui montent en charge horizontalement. Certains utilisent le traitement en mémoire, d’autres des couches de stockage et de calcul en cloud. Les performances dépendent de la manière dont l’architecture sous-jacente gère le stockage, l’indexation et l’exécution des requêtes.

Quels types de modèles ces logiciels utilisent-ils pour l’analyse ?

De nombreux systèmes recourent à la modélisation statistique, au clustering ou à des algorithmes prédictifs pour analyser les segments clients. Les techniques précises varient selon les solutions, certaines proposant des modèles prêts à l’emploi, d’autres permettant le développement de modèles personnalisés. Le degré de transparence et de contrôle des modèles dépend de la plateforme.

Prochaine étape :

Si vous êtes en train de comparer les solutions d’analytique client big data, contactez gratuitement un conseiller SoftwareSelect pour des recommandations personnalisées.

Vous remplissez un formulaire et aurez un court entretien pour approfondir vos besoins. Ensuite, vous recevrez une liste restreinte de logiciels à examiner. Ils vous accompagneront même tout au long du processus d’achat, y compris la négociation des tarifs.